なぜユネスコが「人工知能の倫理」を作ったのか?少し気になったので、調べてみました。

ユネスコといえば世界遺産。

「なぜ、ユネスコがAIを?」と思ったので、ユネスコのウェブサイトを調べてみました。

ユネスコとは

ユネスコ(国際連合教育科学文化機関、United Nations Educational, Scientific and Cultural Organization U.N.E.S.C.O.)は、諸国民の教育、科学、文化の協力と交流を通じて、国際平和と人類の福祉の促進を目的とした国際連合の専門機関です。

ユネスコ憲章前文

ユネスコのビジョン

政府の政治的・経済的な取り決めだけでは、人々の永続的かつ誠実な支持を得ることはできません。平和は、対話と相互理解の上に築かれなければならない。平和は、人類の知的・道徳的な連帯の上に築かれなければならない。

この精神に基づき、ユネスコは、人々が憎しみや不寛容のない地球市民として生きるための教育ツールを開発しています。ユネスコは、すべての子どもと市民が質の高い教育を受けられるように活動しています。ユネスコは、文化遺産とすべての文化の平等な尊厳を促進することで、国家間の結びつきを強めています。ユネスコは、開発と協力のためのプラットフォームとして、科学プログラムと政策を促進します。ユネスコは、表現の自由を基本的な権利として支持し、民主主義と発展のための重要な条件としています。ユネスコはアイデアの実験室として、各国が国際基準を採用するのを支援し、アイデアの自由な流れと知識の共有を促進するプログラムを管理しています。

ユネスコの創設ビジョンは、人種差別や反ユダヤ主義の暴力が行われた世界大戦を受けて生まれたものです。それから70年、多くの解放闘争を経て、ユネスコの使命はこれまでと同様に適切なものとなっています。文化の多様性が攻撃され、新しい形の不寛容、科学的事実の否定、表現の自由への脅威が、平和と人権に挑戦しています。これに対して、ユネスコの義務は、教育、科学、文化のヒューマニスト的使命を再確認することにあります。

https://www.unesco.org/en/introducing-unesco

ユネスコといえば「世界遺産」というのはステレオタイプな見方でした。失礼しました。

「平和は、人類の知的・道徳的な連帯の上に築かれなければならない」とあるように、台頭するAIという新たな技術は道徳的に利用する必要がある。

その教育ツールとなるのが、今回採択された「AIの倫理」ということですね。

AIの倫理

ユネスコ事務局長がユネスコ加盟国が総会で採択した人工知能の倫理。これは、AI倫理に関する史上初の世界基準です。

このAIの倫理は、人工知能の健全な発展を保証するために必要な法的インフラの構築を導く共通の価値観と原則を定義したものです。

AIは広く普及しています。航空券の予約、自動運転、パーソナライズされたニュースなど、私たちの日常生活の多くにAIが利用されています。AIは政府や民間企業の意思決定をサポートしています。

AI技術は、がん検診や障がい者のための環境構築など、高度な専門分野で目覚ましい成果を上げています。気候変動や世界的な飢餓などの地球規模の問題に対処し、経済援助を最適化することで貧困の削減にも貢献しています。

しかし、このAIは、これまでに見ない新たな課題ももたらしています。ジェンダーや民族による偏見の増加、プライバシーや尊厳・主体性に対する重大な脅威、大量監視の危険性、信頼性の低いAI技術の利用増加などが見られます。これらの課題に対する答えを示す普遍的な基準は、これまでありませんでした。

2018年、ユネスコ事務局長は、人工知能の利用に関する倫理的な枠組みを世界に提供するという野心的なプロジェクトを開始しました。3年後、世界中から何百人もの専門家が動員され、激しい国際交渉が行われたおかげで、193のユネスコ加盟国がこの倫理的枠組みを正式に採用することができました。

AI倫理の勧告の内容

勧告は、AIが社会にもたらす利点を実現し、それに伴うリスクを低減することを目的としています。

デジタルトランスフォーメーションが人権を促進し、持続可能な開発目標の達成に貢献することを保証し、透明性、説明責任、プライバシーに関する問題に取り組み、データガバナンス、教育、文化、労働、ヘルスケア、経済に関する行動指向の政策章を設けています。

- データの保護

勧告では、技術企業や政府が行っている行動を超えて、個人データの透明性、代理権、管理権を確保することにより、個人の保護を強化することを求めています。

勧告では、個人はすべて、自分の個人データの記録にアクセスしたり、記録を消去したりすることができるべきだとしています。

また、データ保護や、個人が自分のデータについて知り、コントロールする権利を向上させるための活動も含まれています。

また、世界中の規制機関がデータ保護を実施できるようにすることも含まれています。

- ソーシャルスコアリングと大量監視の禁止

勧告では、ソーシャル・スコアリングや大量監視のためのAIシステムの使用を明確に禁止しています。

この種の技術は非常に侵襲的であり、人権や基本的自由を侵害し、広範囲に使用されています。

勧告では、規制の枠組みを構築する際に、加盟国は最終的な責任と説明責任は常に人間にあることを考慮すべきであり、AI技術自体に法的な人格を与えるべきではないと強調しています。

- モニタリングと評価の支援

勧告では、その実施を支援するツールの基盤も整えられています。

「倫理的影響評価」は、AIシステムを開発・導入する国や企業が、そのシステムが個人や社会、環境に与える影響を評価するのに役立つことを目的としています。

「準備状況評価」は、加盟国が法的・技術的インフラの面でどれだけ準備ができているかを評価するのに役立ちます。

これらツールは、各国の制度的能力の向上を支援し、倫理が実際に実施されるようにするために取るべき適切な措置を提言します。

さらに、この勧告では、メンバー国に対し、独立したAI倫理担当者の役割や、監査や継続的なモニタリングの取り組みを監督するその他のメカニズムを追加することを検討するよう促しています。

- 環境の保護

勧告では、AI関係者は、気候変動との戦いや環境問題への取り組みにおいてAIがより重要なツールとなるよう、データ、エネルギー、資源の効率的なAI手法を支持すべきであると強調しています。

勧告では、各国政府に対し、AIシステムのライフサイクルにおける直接的および間接的な環境影響を評価するよう求めています。

これには、カーボンフットプリント、エネルギー消費、AI技術の製造をサポートするための原材料の抽出による環境影響が含まれます。

また、AIシステムやデータインフラの環境負荷を低減することも目的としています。

勧告では、政府にグリーンテクノロジーへの投資を促すとともに、AIシステムが環境に与える不均衡な悪影響がある場合は、使用すべきではないと指導しています。

AIなどの新興技術は、良い結果をもたらす絶大な能力があることを証明しています。しかし、すでに分断された不平等な世界を悪化させているその負の影響を抑制する必要があります。AIの開発は、法の支配を遵守し、被害を回避するとともに、被害が発生した場合には、被害を受けた人々への説明責任と救済メカニズムを確保する必要があります。

日本におけるAI社会原則の議論

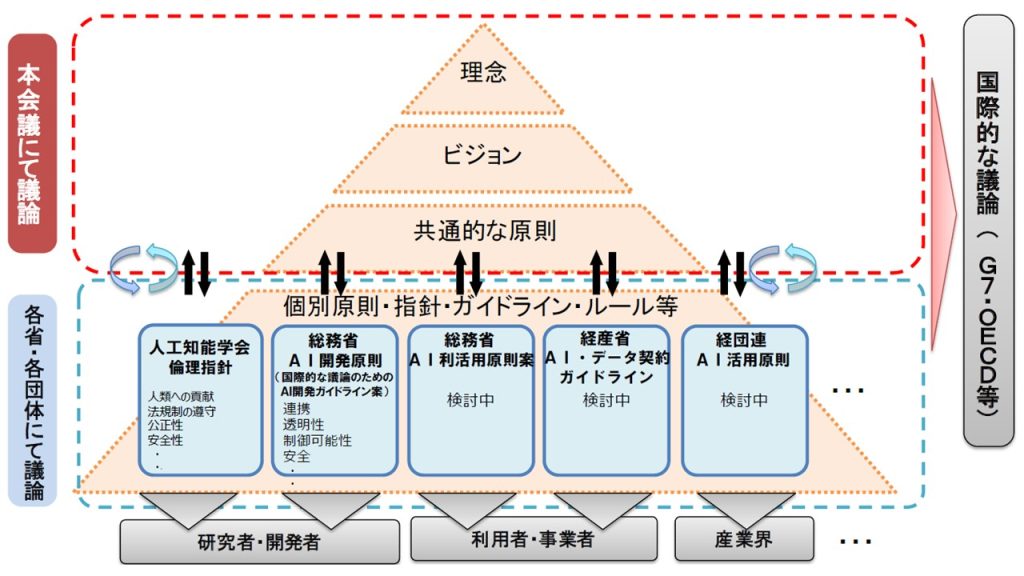

AIに関するグローバルな議論の活性化を踏まえ、日本でも、人工知能技術戦略会議のもとに「人間中心のAI社会原則検討会議」が設置されました。

この検討会議では、AIをより良い形で社会実装し共有するための基本原則となる人間中心のAI社会原則を策定し、国際的な議論に供することを目的としています。

この検討会議が取りまとめた「人間中心の社会原則」には、倫理という言葉が2回登場しています。

AI を前提とした社会において、我々は、人々の間に格差や分断が生じたり、弱者が生まれたりすることは望まない。したがって、AIに関わる政策決定者や経営者は、AIの複雑性や、意図的な悪用もありえることを勘案して、AIの正確な理解と、社会的に正しい利用ができる知識と倫理を持っていなければならない。AIの利用者側は、AIが従来のツールよりはるかに複雑な動きをするため、その概要を理解し、正しく利用できる素養を身につけていることが望まれる。一方、AIの開発者側は、AI技術の基礎を習得していることが当然必要であるが、それに加えて、社会で役立つAI の開発の観点から、AIが社会においてどのように使われるかに関するビジネスモデル及び規範意識を含む社会科学や倫理等、人文科学に関する素養を習得していることが重要になる。

人間中心の社会原則

こうした検討に先立ち、人工知能学会倫理員会が「人工知能学会倫理指針」を発表しました。

以下の9つの観点が列挙されています。

- 人類への貢献

- 法規制の順守

- 他社のプライバシーの尊重

- 公正性

- 安全性

- 誠実な振る舞い

- 社会に対する責任

- 社会との対話と自己研鑽

- 人工知能への倫理順守の要請

この倫理指針は、アクチュアリーのプロフェッショナリズムにも通じる概念ですね。